Server-side rendering vs client-side: wat AI-crawlers écht zien op je site

Waarom AI-crawlers uw JavaScript niet uitvoeren

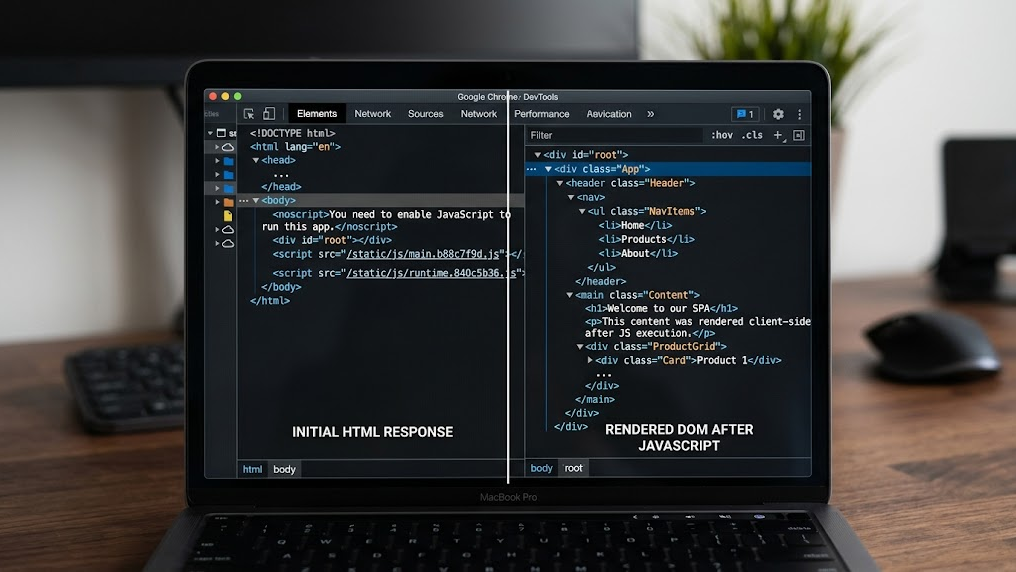

U investeert in een razendsnelle single-page applicatie met React, Vue of Angular. Uw bezoekers zien een prachtige interface. Maar weet u wat de crawlers van ChatGPT, Perplexity en Google AI Overviews zien? In veel gevallen: een lege pagina.

Het fundamentele probleem is simpel. AI-crawlers voeren zelden JavaScript uit. Terwijl een browser uw client-side gerenderde content keurig opbouwt, ontvangt een AI-bot enkel de kale HTML die uw server retourneert. Als die HTML leeg is op het moment van de eerste response, bestaat uw content voor AI simpelweg niet. Dit is geen theoretisch risico. Het is de realiteit voor duizenden websites die onbedoeld onzichtbaar zijn in AI-antwoorden.

Binnen Generative Engine Optimization (GEO) is server-side rendering daarom geen luxe. Het is een technische voorwaarde voor AI-zichtbaarheid.

Het verschil tussen SSR en CSR voor AI-crawlers

De keuze tussen server-side rendering (SSR) en client-side rendering (CSR) bepaalt of uw content überhaupt in de index van AI-engines terechtkomt. Hieronder de kernverschillen vanuit het perspectief van een AI-crawler.

| Kenmerk | Server-side rendering (SSR) | Client-side rendering (CSR) |

|---|---|---|

| HTML bij eerste request | Volledig gevuld met content | Leeg of minimaal (div id="root") |

| JavaScript-afhankelijkheid | Minimaal voor content | Volledig voor content |

| Crawlbaarheid door AI-bots | Hoog | Laag tot niet-bestaand |

| Time-to-content voor bots | Direct (eerste response) | Afhankelijk van JS-executie |

| Schema markup zichtbaarheid | Direct beschikbaar in HTML | Vaak pas na JS-rendering |

De bots van OpenAI (GPTBot) en Anthropic (ClaudeBot) opereren fundamenteel anders dan een Chrome-browser. Ze parsen de initiële HTML-response en gaan verder. Er is geen wachttijd voor JavaScript-frameworks om de DOM op te bouwen. Wat niet in de eerste response zit, wordt genegeerd.

Zo valideert u wat AI-crawlers werkelijk ontvangen

Voordat u uw architectuur aanpast, moet u eerst vaststellen wat de huidige situatie is. Dit is de nulmeting van uw technische GEO-hygiëne.

Handmatige validatie via de terminal:

Voer een simpele curl-request uit om de server-response te inspecteren:

curl -s https://uwdomein.nl | head -100Ziet u uw paginacontent terug in de output? Dan levert uw server gevulde HTML. Ziet u alleen een leeg <div> element en verwijzingen naar JavaScript-bundles? Dan is uw content onzichtbaar voor AI-crawlers.

Geautomatiseerde validatie:

De GrowthScope Quickscan voert deze server-side rendering check automatisch uit. Binnen 2 tot 5 minuten weet u of uw technische setup AI-crawlers blokkeert en ontvangt u een concreet actieplan.

De drie technische fixes die uw content zichtbaar maken

Als uw validatie uitwijst dat AI-crawlers een lege pagina ontvangen, zijn dit de drie routes naar een oplossing.

1. Migreer naar server-side rendering of static site generation

Frameworks als Next.js (React) en Nuxt.js (Vue) bieden ingebouwde SSR- en SSG-modi. Bij SSR genereert de server de volledige HTML per request. Bij SSG wordt de HTML vooraf gegenereerd tijdens de build. Beide methoden garanderen dat de eerste response gevulde content bevat.

- SSR is ideaal voor dynamische pagina's met frequente updates

- SSG is optimaal voor relatief statische content zoals blogposts en productpagina's

- ISR (Incremental Static Regeneration) combineert het beste van beide

2. Configureer uw robots.txt en llms.txt correct

Zelfs met perfecte SSR kan een verkeerd geconfigureerde robots.txt uw content blokkeren. AI-crawlers respecteren deze instructies. Controleer of GPTBot, ClaudeBot en PerplexityBot niet per ongeluk worden geblokkeerd.

Daarnaast is een llms.txt bestand inmiddels een essentieel onderdeel van uw technische GEO-setup. Dit bestand vertelt AI-modellen expliciet welke content relevant is en hoe uw organisatie beschreven moet worden. GrowthScope genereert automatisch een llms.txt template op basis van uw domein.

3. Implementeer schema markup in de server-response

Schema markup (structured data) is de vertaling van uw website naar een taal die AI begrijpt. Cruciaal: deze markup moet aanwezig zijn in de initiële HTML-response, niet pas na JavaScript-executie. Embed uw JSON-LD schema direct in de server-gerenderde HTML.

Prioriteer deze schema-types voor AI-zichtbaarheid:

- Organization (bedrijfsinformatie)

- FAQPage (veelgestelde vragen)

- Article of TechArticle (blogcontent)

- Product (productpagina's)

Integreer SSR-validatie in uw development workflow

Een eenmalige fix is niet voldoende. Elke nieuwe feature, elke deployment kan regressie veroorzaken in uw server-side rendering. Daarom hoort een SSR-check thuis in uw CI/CD-pipeline.

Praktische integratie in sprints:

- Voeg een pre-deployment check toe die de HTML-output van kritieke pagina's valideert

- Neem de GEO Readiness Score op als Technical Health KPI in uw maandelijkse sprint review

- Plan een kwartaalaudit om nieuwe content te toetsen op AI-crawlbaarheid

De GrowthScope Dieptescan analyzeert 25 brancherelevante queries en toont exact hoe uw content presteert op ChatGPT, Perplexity, Google AI Overviews en Claude. Zo monitort u of uw technische aanpassingen daadwerkelijk resulteren in AI-zichtbaarheid.

Uw volgende stap: van onzichtbaar naar citeerbaar

Server-side rendering is de fundering. Zonder die fundering zijn al uw content-inspanningen voor AI-engines onzichtbaar.

De fix is technisch helder. De impact is direct meetbaar.

Start met de validatie. Inspecteer uw server-response, corrigeer de rendering-methode en configureer uw llms.txt en robots.txt. Vervolgens meet u het resultaat met een GEO-audit die uw score kwantificeert van 0 tot 100.

Wilt u vandaag nog weten of AI-crawlers uw content kunnen zien? Start uw Quickscan en ontvang binnen minuten uw technische GEO-status.