Wat is llms.txt en waarom heeft elke moderne website er een nodig

Llms.txt: de technische standaard die bepaalt of AI u vindt

Uw website kan perfect scoren op traditionele SEO en toch volledig onzichtbaar zijn voor AI-modellen zoals ChatGPT, Claude en Gemini. De oorzaak ligt niet in uw content, maar in een ontbrekend bestand: llms.txt. Dit bestand fungeert als een gestructureerde instructieset waarmee AI-crawlers uw site correct kunnen interpreteren en indexeren.

Vergelijk het met robots.txt, maar dan specifiek ontworpen voor large language models. Waar robots.txt zoekmachines vertelt welke pagina's zij mogen crawlen, vertelt llms.txt aan AI-systemen hoe zij uw content moeten begrijpen. Zonder dit bestand laten AI-crawlers uw site links liggen of interpreteren zij uw informatie onjuist.

Bij GrowthScope zien we vanuit meer dan 10 jaar ervaring in digitale zichtbaarheid dat de technische hygiëne van websites structureel achterloopt op de snelheid waarmee AI-modellen zich ontwikkelen. De introductie van llms.txt is het antwoord op dat gat.

Waarom robots.txt alleen niet meer volstaat

Robots.txt is gebouwd voor een tijdperk waarin Googlebot de dominante crawler was. AI-crawlers van OpenAI (GPTBot), Anthropic (ClaudeBot) en Google (Gemini) opereren fundamenteel anders. Ze zoeken niet naar pagina's om te indexeren, maar naar gestructureerde kennis om te verwerken.

Het gevolg: uw robots.txt kan volledig correct geconfigureerd zijn terwijl AI-crawlers uw site toch niet goed ontsluiten. Ze missen context over de hiërarchie van uw content, de relaties tussen pagina's en de autoriteit van specifieke secties.

Kenmerken robots.txt en llms.txt

| Kenmerk | robots.txt | llms.txt |

|---|---|---|

| Doelgroep | Traditionele zoekmachine-crawlers | AI-modellen en LLM-crawlers |

| Functie | Toestemming geven of blokkeren | Context en structuur bieden |

| Formaat | Disallow/Allow regels | Gestructureerde metadata |

| Impact op AI-zichtbaarheid | Indirect | Direct |

Hoe llms.txt technisch werkt

Het llms.txt bestand plaatst u in de root van uw domein, exact zoals u dat doet met robots.txt. Het bestand volgt een eenvoudige, leesbare structuur die AI-modellen vertelt wat uw site bevat, welke secties prioriteit hebben en hoe de content geïnterpreteerd moet worden.

De basisstructuur van een llms.txt bestand

Een functioneel llms.txt bestand bevat minimaal de volgende elementen:

- Sitenaam en beschrijving: een beknopte uitleg van uw organisatie en expertise

- Contentcategorieën: een overzicht van de belangrijkste secties met hun URL's

- Prioriteitsaanduiding: welke pagina's de hoogste autoriteit hebben

- Contactinformatie: hoe het AI-model uw organisatie moet attribueren

Voorbeeldimplementatie

llms.txt

Naam

GrowthScope - GEO & AI Zichtbaarheid

Beschrijving

GrowthScope levert strategische analyses en tools voor generatieve engine-optimalisatie. Productie en ontwikkeling vanuit Schijndel, uitgevoerd door eigen vakmensen.

Primaire content

/quickscan - Technische AI-zichtbaarheidsanalyse

/blog - Kennisbank over GEO en AI-crawlability

/diensten - Overzicht van alle services

Prioriteit

/quickscan

/blogDit voorbeeld illustreert hoe compact en effectief het bestand kan zijn. De drempel is laag, maar de impact op crawlability is meetbaar.

Stap voor stap llms.txt implementeren op uw website

De implementatie kost een ervaren developer minder dan 30 minuten. Volg dit stappenplan om het bestand correct te deployen.

Stap 1: audit uw huidige crawlability

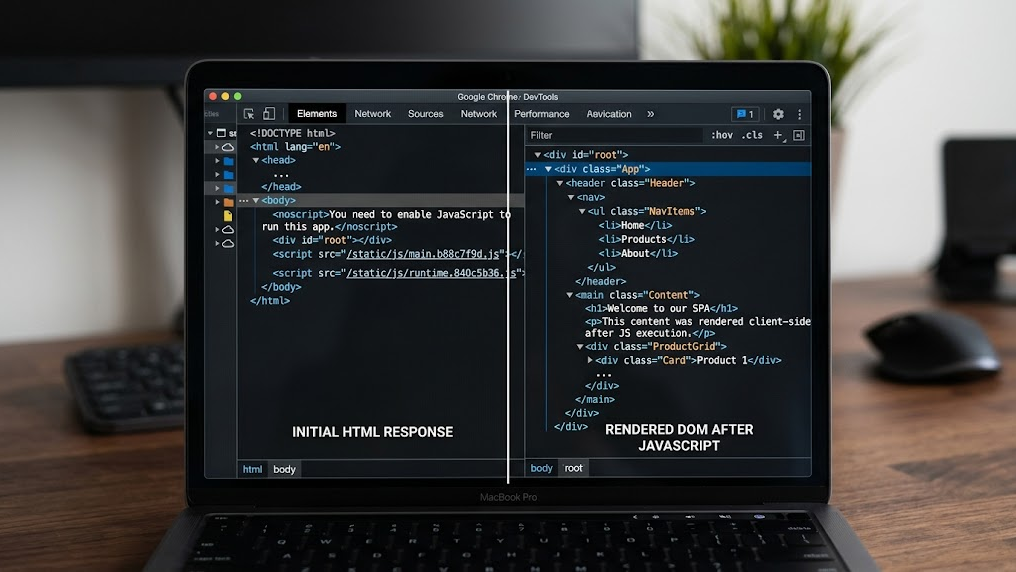

Voordat u llms.txt toevoegt, valideert u eerst of uw server-side rendering correct werkt. AI-crawlers kunnen geen JavaScript-gerenderde content verwerken als uw server geen pre-rendered HTML levert. Controleer ook of GPTBot en ClaudeBot niet onbedoeld geblokkeerd worden in uw huidige robots.txt.

Stap 2: definieer uw contentstructuur

Breng de hiërarchie van uw website in kaart. Identificeer welke pagina's de hoogste informatiewaarde bevatten en welke secties als autoriteitsbronnen moeten dienen. Focus op pagina's met unieke expertise die AI-modellen als betrouwbare bron kunnen citeren.

Stap 3: schrijf en deploy het bestand

Maak het llms.txt bestand aan volgens de structuur uit het voorbeeld hierboven. Upload het naar de root van uw domein zodat het bereikbaar is op uwdomein.nl/llms.txt. Verifieer na deployment dat het bestand correct wordt geserveerd met een 200 HTTP-statuscode.

Stap 4: valideer en monitor

Na deployment controleert u of AI-crawlers het bestand daadwerkelijk ophalen. Check uw serverlogboeken op verzoeken van GPTBot, ClaudeBot en andere AI user agents. Integreer deze validatie als terugkerend onderdeel van uw technische health checks.

Schema markup en llms.txt: de combinatie die AI-zichtbaarheid verankert

Llms.txt alleen is noodzakelijk maar niet voldoende. De combinatie met correcte Schema markup (JSON-LD) versterkt het signaal dat AI-modellen ontvangen exponentieel. Schema markup biedt gestructureerde data op paginaniveau, terwijl llms.txt de sitewide context levert.

Onze eigen vakmensen bij GrowthScope hebben deze combinatie getest op tientallen domeinen. De conclusie is consistent: websites met zowel llms.txt als gevalideerde Schema markup worden significant vaker geciteerd in AI-gegenereerde antwoorden.

Concrete acties die u kunt ondernemen:

- Implementeer Organization en WebSite schema op uw homepage

- Voeg Article schema toe aan al uw blogposts

- Gebruik FAQ schema voor pagina's met veelgestelde vragen

- Valideer alles via de Schema Markup Validator van Google

GrowthScope Quickscan

De GrowthScope Quickscan voert deze validatie binnen 2 tot 5 minuten uit en genereert een direct bruikbaar llms.txt template op basis van uw specifieke sitestructuur. Dat reduceert uw time-to-fix van uren naar minuten. Voor technisch leads die hun infrastructuur toekomstbestendig willen maken, is dit de meest efficiënte eerste stap.

AI-zichtbaarheid is geen marketingtrend. Het is een infrastructuurvereiste. En llms.txt is het fundament.